|

Коэффициент корреляции, его значение и характеристика

|

|

|

|

Коэффициент корреляции, его значение и характеристика. Выбор формы уравнения тренда

Коэффициент корреляции, его значение и характеристика

Один из наиболее общих законов объективного мира - закон всеобщей связи и зависимости между явлениями. Естественно, что, исследуя явления в самых различных областях, статистика неизбежно сталкивается с зависимостями как между количественными, так и между качественными показателями, признаками. Ее задача - обнаружить (выявить) такие зависимости и дать им количественную характеристику.

Среди взаимосвязанных признаков (показателей) одни могут рассматриваться как определенные факторы, влияющие на изменение других (факторные), а вторые (результативные) - как следствие, результат влияния первых.

Существует 2 вида связи между отдельными признаками: функциональная и стохастическая (статистическая), частным случаем которой является корреляционная [1].

Связь между двумя переменными x и y называется функциональной, если определенному значению переменной x строго соответствует одно или несколько значений другой переменной y, и с изменением значения x значение y меняется строго определенно. Такие связи обычно встречаются в точных науках. Например, известно, что площадь квадрата равна квадрату его стороны (S = a2). Это соотношение характерно для каждого единичного случая (квадрата), это так называемая жестко детерминированная связь. Такие связи можно встретить и в области экономических явлений. Например, при простой сдельной оплате труда связь между оплатой труда y и количеством изготовленных изделий x при фиксированной расценке за одну деталь, например 5 руб., легко выразить формулой  . Для изучения функциональных связей применяется индексный метод.

. Для изучения функциональных связей применяется индексный метод.

|

|

|

Существуют и иного рода связи, где взаимно действуют многие факторы, комбинация которых приводит к вариации значений результативного признака (показателя) при одинаковом значении факторного признака. Например, при изучении зависимости величины таможенных платежей, поступающих в федеральный бюджет, от количества товаров, перемещаемых через таможенную границу государства, (или от стоимостного товарооборота) последние будут рассматриваться как факторный признак, а величина таможенных платежей - как результативный.

Между ними нет жестко детерминированной связи, т.е. при одном и том же количестве перемещенных через таможенную границу товаров (или стоимости товарооборота) величина таможенных платежей, перечисленных разными таможнями будет различной, так как кроме количества товаров, перемещаемых через таможенную границу государства, (или стоимость товарооборота) на величину таможенных платежей влияет много других факторов (различная номенклатура товаров, для которых применяются различные таможенные пошлины, сборы и льготы; различные таможенные режимы перемещения товаров через таможенную границу и др.), комбинация которых вызывает вариацию величины таможенных платежей.

Там, где взаимодействует множество факторов, в том числе и случайных, выявить зависимости, рассматривая единичный случай, невозможно. Такие связи можно обнаружить только при массовом наблюдении как статистические закономерности. Выявленная таким образом связь именуется стохастической.

Корреляционная связь - понятие более узкое, чем стохастическая связь, это ее частный случай. Именно корреляционные связи являются предметом изучения статистики.

Корреляционная связь - это связь, проявляющаяся при большом числе наблюдений в виде определенной зависимости между средним значением результативного признака и признаками-факторами. Другими словами, корреляционную связь условно можно рассматривать как своего рода функциональную связь средней величины одного признака (результативного) со значением другого (или других). При этом, если рассматривается связь средней величины результативного показателя y с одним признаком-фактором x, корреляция называется парной, а если факторных признаков 2 и более (x1, x2, …, xm) - множественной.

|

|

|

По характеру изменений x и y в парной корреляции различают прямую и обратную связь. При прямой связи значения обоих признаков изменяются в одном направлении, т.е. с увеличением (уменьшением) значений x увеличиваются (уменьшаются) и значения y. При обратной связи значения факторного и результативного признаков изменяются в разных направлениях.

Изучение корреляционных связей сводится в основном к решению следующих задач [1]:

1) выявление наличия (отсутствия) корреляционной связи между изучаемыми признаками;

2) измерение тесноты связи между двумя (и более) признаками с помощью специальных коэффициентов (эта часть исследования именуется корреляционным анализом);

) определение уравнения регрессии - математической модели, в которой среднее значение результативного признака у рассматривается как функция одной или нескольких переменных - факторных признаков (эта часть исследования именуется регрессионным анализом).

Для выявления наличия и характера корреляционной связи между двумя признаками в статистике используется ряд методов [1]:

. Рассмотрение параллельных данных (значений x и y в каждой из n единиц). Единицы наблюдения необходимо расположить по возрастанию значений факторного признака х и затем сравнить с ним (визуально) поведение результативного признака у.

. Графический метод - это графическое изображение корреляционной зависимости. Для этого, имея n взаимосвязанных пар значений x и y и пользуясь прямоугольной системой координат, каждую такую пару изображают в виде точки на плоскости с координатами x и y. Совокупность полученных точек представляет собой корреляционное поле, а соединяя последовательно нанесенные точки отрезками, получают ломаную линию, именуемую эмпирической линией регрессии.

|

|

|

3. Метод аналитических группировок используется при большом числе наблюдений для выявления корреляционной связи между двумя количественными признаками. Чтобы выявить наличие корреляционной связи между двумя признаками, проводится группировка единиц совокупности по факторному признаку х и для каждой выделенной группы рассчитывается среднее значение результативного признака  . Если результативный признак у зависит от факторного х, то в изменении среднего значения

. Если результативный признак у зависит от факторного х, то в изменении среднего значения  будет прослеживаться определенная закономерность.

будет прослеживаться определенная закономерность.

. Метод корреляционных таблиц предполагает комбинационное распределение единиц совокупности по двум количественным признакам. Такая таблица строится по типу «шахматной», т.е. в подлежащем (строках) таблицы выделяются группы по факторному признаку х, а в сказуемом (столбцах) - по результативному у (или наоборот), а в клетках таблицы на пересечении х и у показано число случаев совпадения каждого значения х с соответствующим значением у.

. Коэффициент корреляции знаков (Фехнера) - простейший показатель тесноты связи, основанный на сравнении поведения отклонений индивидуальных значений каждого признака (x и y) от своей средней величины. При этом во внимание принимаются не величины отклонений ( ) и (

) и ( ), а их знаки («+» или «-»). Определив знаки отклонений от средней величины в каждом ряду, рассматривают все пары знаков и подсчитывают число их совпадений (С) и несовпадений (Н). Тогда коэффициент Фехнера рассчитывается как отношение разности чисел пар совпадений и несовпадений знаков к их сумме, т.е. к общему числу наблюдаемых единиц [1]:

), а их знаки («+» или «-»). Определив знаки отклонений от средней величины в каждом ряду, рассматривают все пары знаков и подсчитывают число их совпадений (С) и несовпадений (Н). Тогда коэффициент Фехнера рассчитывается как отношение разности чисел пар совпадений и несовпадений знаков к их сумме, т.е. к общему числу наблюдаемых единиц [1]:

(1)

(1)

Очевидно, что если знаки всех отклонений по каждому признаку совпадут, то КФ=1, что характеризует наличие прямой связи. Если все знаки не совпадут, то КФ=-1 (обратная связь). Если же SС=SН, то КФ=0. Итак, как и любой показатель тесноты связи, коэффициент Фехнера может принимать значения от 0 до ±1. Однако, если КФ=1, то это ни в коей мере нельзя воспринимать как свидетельство функциональной зависимости между х и у.

|

|

|

6. Линейный коэффициент корреляции - самый популярный измеритель тесноты линейной связи между двумя количественными признаками x и y. Он основан на предположении, что при полной независимости признаков x и у отклонения значений факторного признака от средней ( ) носят случайный характер и должны случайно сочетаться с различными отклонениями (

) носят случайный характер и должны случайно сочетаться с различными отклонениями ( ). При наличии значительного перевеса совпадений или несовпадений таких отклонений делается предположение о наличии связи между x и y.

). При наличии значительного перевеса совпадений или несовпадений таких отклонений делается предположение о наличии связи между x и y.

В отличие от КФ в линейном коэффициенте корреляции учитываются не только знаки отклонений от средних величин, но и значения самих отклонений, выраженные для сопоставимости в единицах среднего квадратического отклонения t [1]:

и

и  (2)

(2)

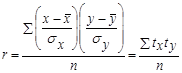

Линейный коэффициент корреляции r представляет собой среднюю величину из произведений нормированных отклонений для x и у [1]:

(3)

(3)

или:

(4)

(4)

Числитель формулы (4), деленный на n, представляющий собой среднее произведение отклонений значений двух признаков от их средних значений, называется коэффициентом ковариации - это мера совместной вариации факторного x и результативного y признаков [1]:

(5)

(5)

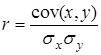

Недостатком коэффициента ковариации является то, что он не нормирован, в отличие от линейного коэффициента корреляции. Очевидно, что линейный коэффициент корреляции представляет собой частное от деления ковариации между х и у на произведение их средних квадратических отклонений [1]:

(6)

(6)

Путем несложных математических преобразований можно получить и другие модификации формулы линейного коэффициента корреляции, например [1]:

(7)

(7)

(8)

(8)

(9)

(9)

Линейный коэффициент корреляции может принимать значения от -1 до +1, причем знак определяется в ходе решения.

Например, если  , то r по формуле (7) будет положительным, что характеризует прямую зависимость между х и у, в противном случае (r<0) - обратную связь. Если

, то r по формуле (7) будет положительным, что характеризует прямую зависимость между х и у, в противном случае (r<0) - обратную связь. Если  , то r=0, что означает отсутствие линейной зависимости между х и у, а при r=1 - функциональная зависимость между х и у. Следовательно, всякое промежуточное значение r от 0 до 1 характеризует степень приближения корреляционной связи между х и у к функциональной.

, то r=0, что означает отсутствие линейной зависимости между х и у, а при r=1 - функциональная зависимость между х и у. Следовательно, всякое промежуточное значение r от 0 до 1 характеризует степень приближения корреляционной связи между х и у к функциональной.

Существует эмпирическое правило (шкала Чэддока) для оценки тесноты связи, представленное в таблице 1 [1].

Таблица 1 - Шкала Чэддока

| | r | | Теснота связи |

| менее 0,1 | отсутствует линейная связь |

| 0,1 ÷ 0,3 | слабая |

| 0,3 ÷ 0,5 | умеренная |

| 0,5 ÷ 0,7 | заметная |

| более 0,7 | сильная (тесная) |

Таким образом, коэффициент корреляции при линейной зависимости служит как мерой тесноты связи, так и показателем, характеризующим степень приближения корреляционной зависимости между х и у к линейной. Поэтому близость значения r к 0 в одних случаях может означать отсутствие связи между х и у, а в других свидетельствовать о том, что зависимость не линейная.

|

|

|

|

|

|