|

Основные приемы изучения взаимосвязей

|

|

|

|

Для изучения, измерения и количественного выражения взаимосвязей между явлениями статистикой применяются различные методы, такие как: метод сопоставления параллельных рядов, балансовый, графический, методы аналитических группировок, дисперсионного и корреляционного анализа.

Метод параллельных рядов заключается в том, что полученные в результате сводки и обработки материалы располагают в виде параллельных рядов и сопоставляют их между собой для установления характера и тесноты связи.

Балансовый метод состоит в том, что данные взаимосвязанных показателей изображаются в виде таблицы и располагаются таким образом, чтобы итоги между отдельными ее частями были равны, т.е. чтобы был баланс. Балансовый метод используется для характеристики взаимосвязи между производством и распределением продуктов, денежными доходами и расходами населения и т.д. Почти все внутренние и внешние хозяйственные связи выражаются в виде балансов.

Метод аналитических группировок. Сущность метода аналитических группировок состоит в том, что единицы статистической совокупности группируются, как правило, по факторному признаку и для каждой группы рассчитывается средняя или относительная величина по результативному признаку. Затем изменения средних или относительных значений результативного признака сопоставляются с изменениями факторного признака для выявления характера связи между ними.

Дисперсионный анализ дает прежде всего возможность определить значение систематической и случайной вариаций в общей вариации, а также установить роль интересующего нас фактора в изменении результативного признака.

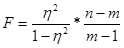

Для характеристики тесноты корреляционной связи между признаками в аналитических группировках межгрупповую дисперсию сопоставляют с общей. Это сопоставление называется корреляционным отношением и обозначается:

|

|

|

(8.5.)

(8.5.)

Оно характеризует долю вариации результативного признака, вызванной действием факторного признака, положенного в основание группировки. Корреляционное отношение по своему абсолютному значению колеблется в пределах от 0 до 1. Чем ближе корреляционное отношение к 1, тем большее влияние оказывает факторный признак на результативный. Если же факторный признак не влияет на результативный, то вариация, обусловленная им, будет равна нулю (d 2 = 0) и корреляционное отношение также будет равно нулю (h2 = 0), что говорит о полном отсутствии связи. И наоборот, если результативный признак изменяется только под воздействием одного факторного признака, то вариация, обусловленная этим признаком, будет равна общей вариации (h2=h2 ) и корреляционное отношение будет равно единице (h2 = 1), что говорит о существовании полной связи.

Дисперсионный анализ позволяет не только определить роль случайной и систематической вариаций в общей вариации, но и оценить достоверность вариации, обнаруженной методом аналитических группировок. Определение достоверности вариации дает возможность с заданной степенью вероятности установить, вызвана ли межгрупповая вариация признаком, положенным в основание группировки, или она является результатом действия случайных причин. Для оценки существенности корреляционного отношения пользуются критическими значениями корреляционного отношения h2при разных уровнях вероятности или значимости a.

Уровень значимости — это достаточно малое значение вероятности, отвечающее событиям, которые в данных условиях исследования будут считаться практически невозможными. Появление такого события считается указанием на неправильность начального предположения. Чаще всего пользуются уровнями a = 0,05 или a = 0,01. Критические значения корреляционного отношения содержатся в специальных таблицах.

|

|

|

В этих таблицах распределение h2 при случайных выборках зависит от числа степеней свободы факторной и случайной дисперсии. Число степеней свободы факторной дисперсии равно:

К1=m-1 (8.6.)

где m — число групп, а для случайной дисперсии:

K1=n – m (8.7.)

где п — число вариант; m — число групп.

При проверке существенности связи чаще пользуются критерием Фишера, потому что при больших числах степеней свободы его табличные значения мало изменяются в отличие от корреляционного отношения, которое требует более громоздких таблиц. Критерий Фишера представляет собой отношение межгрупповой дисперсии к средней из внутригрупповых дисперсий, исчисленных с учетом числа степеней свободы:

(8.8)

(8.8)

Для этих отношений составляются таблицы, по которым можно определить, какая величина F при данном числе степеней свободы по факторной вариации (K1) и остаточной вариации (К2 ) дает основание утверждать с определенной вероятностью (например, 0,95; 0,99), что положенный в основание группировки признак является существенным, или не дает такого основания, и, следовательно, группировочный признак является несущественным.

Зная корреляционное отношение, можно определить критерий Фишера по следующей формуле:

(8.9.)

(8.9.)

Подобный дисперсионный анализ может проводиться при группировке по одному факторному признаку или при комбинационной группировке по двум и более факторам.

В таком случае необходима оценка достоверности влияния не только каждого положенного в основание группировки фактора в отдельности, но и результата их взаимодействия. Последний определяется как разность между эффектом совместного влияния двух группировочных признаков и суммой эффектов влияния каждого из этих факторных признаков, взятых в отдельности. Это осложняет расчеты суммы квадратов отклонений и числа степеней свободы вариации. Но сам принцип дисперсионного анализа, основанный на сопоставлении факторной дисперсии со случайной для оценки достоверности результатов статистической группировки, остается применим независимо от числа признаков группировки.

|

|

|

Корреляционный анализ

Корреляционный анализ решает две основные задачи.

Первая задача заключается в определении формы связи, т.е. в установлении математической формы, в которой выражается данная связь. Это очень важно, так как от правильного выбора формы связи зависит конечный результат изучения взаимосвязи между признаками.

Вторая задача состоит в измерении тесноты, т.е. меры связи между признаками с целью установить степень влияния данного фактора на результат. Она решается математически путем определения параметров корреляционного уравнения.

Затем проводятся оценка и анализ полученных результатов при помощи специальных показателей корреляционного метода (коэффициентов детерминации, линейной и множественной корреляции и т.д.), а также проверка существенности связи между изучаемыми признаками.

Определяющая роль в выборе формы связи между явлениями принадлежит теоретическому анализу. Так, например, чем больше размер основного капитала предприятия (факторный признак), тем больше при прочих равных условиях оно выпускает продукции (результативный признак). С ростом факторного признака здесь, как правило, равномерно растет и результативный, поэтому зависимость между ними может быть выражена уравнением прямой Y = а0 + а1 x, которое называется линейным уравнением регрессии.

Параметр а1 называется коэффициентом регрессии и показывает, насколько в среднем отклоняется величина результативного признака у при отклонении величины факторного признаках на одну единицу. При х=0 а0 = Y. Увеличение количества внесенных удобрений приводит, при прочих равных условиях, к росту урожайности, но чрезмерное внесение их без изменения других элементов к дальнейшему повышению урожайности не приводит, а, наоборот, снижает ее. Такая зависимость может быть выражена уравнением параболы Y = а0 + а1 x + а2 x2..

Параметр а2 характеризует степень ускорения или замедления кривизны параболы, и при а2 > 0 парабола имеет минимум, а при а2 < 0 — максимум. Параметр а1 характеризует угол наклона кривой, а параметр а0 — начало кривой.

|

|

|

Однако с помощью теоретического анализа не всегда удается установить форму связи. В таких случаях приходится только предполагать о наличии определенной формы связи. Проверить эти предположения можно при помощи графического анализа, который используется для выбора формы связи между явлениями, хотя графический метод изучения связи применяется и самостоятельно.

Применение методов корреляционного анализа дает возможность выражать связь между признаками аналитически — в виде уравнения — и придавать ей количественное выражение. Рассмотрим применение приемов корреляционного анализа на конкретном примере.

Допустим, что между стоимостью основного капитала и выпуском продукции существует прямолинейная связь, которая выражается уравнением прямой Y = а0 + а1 x. Необходимо найти параметры а0 и a1 что позволит определить теоретические значения Y для разных значений х. Причем а0 и a1 должны быть такими, чтобы было достигнуто максимальное приближение к первоначальным (эмпирическим) значениям теоретических значений Y. Эта задача решается при помощи способа наименьших квадратов, основное условие которого сводится к определению параметров а0 и a1 таким образом, чтобы å (уi - Y) 2 = min.

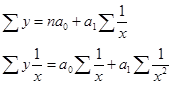

Математически доказано, что условие минимума обеспечивается, если параметры а0 и a1 определяются при помощи системы двух нормальных уравнений, отвечающих требованию метода наименьших квадратов:

åy=na0 +a1åx

åxy=a0*åx 2 (8.10)

Первое уравнение есть сумма всех первоначальных уравнений. Второе получается умножением обеих частей уравнения прямой на один и тот же множитель. Математически доказано, что условие å (уi - Y) 2 = min соблюдается, если в качестве такого множителя принять значение факторного признака, т.е. если уравнение прямой умножить на x.

Кроме рассмотренных функций связи в экономическом анализе часто применяются степенная, показательная и гиперболическая функции.

Степенная функция имеет вид Y = а0 ха1. Параметр a1 степенного уравнения называется показателем эластичности и указывает, на сколько процентов изменится у при возрастании х на 1 %. При х = 1 а0 =. Y.

Для определения параметров степенной функции вначале ее приводят к линейному виду путем логарифмирования: l g y = lg a0 + а1 lg x1, а затем строят систему нормальных уравнений:

(8.11)

(8.11)

Решив систему двух нормальных уравнений, находят логарифмы параметров логарифмической функции а0 и а1 а затем и сами параметры а0 и а1 При помощи степенной функции определяют, например, зависимость между фондом заработной платы и выпуском продукции, затратами труда и выпуском продукции и т.д.

|

|

|

Если факторный признак x растет в арифметической прогрессии, а результативный у — в геометрической, то такая зависимость выражается показательной функцией Y = а0 * а1 2. Для определения параметров показательной функции ее также вначале приводят к линейному виду путем логарифмирования: lg у = lg а0 + х lg a1, а затем строят систему нормальных уравнений:

(8.12)

(8.12)

Вычислив соответствующие данные и решив систему двух нормальных уравнений, находят параметры показательной функции ао и а1.

В ряде случаев обратная связь между факторным и результативным признаками может быть выражена уравнением гиперболы:

(8.13)

(8.13)

|

И здесь задача заключается в нахождении параметров а0 и at при помощи системы двух нормальных уравнений:

(8.14)

При помощи гиперболической функции изучают, например, связь между выпуском продукции и себестоимостью, уровнем издержек обращения (в % к товарообороту) и товарооборотом в торговле, сроками уборки и урожайностью и т.д.

Таким образом, применение различных функций в качестве уравнения связи сводится к определению параметров уравнения по способу наименьших квадратов при помощи системы нормальных уравнений.

В малых совокупностях значение коэффициента регрессии подвержено случайным колебаниям. Поэтому возникает необходимость в определении достоверности коэффициента регрессии. Достоверность коэффициента регрессии определяется так же, как и в выборочном наблюдении, т.е. устанавливаются средняя и предельная ошибки для выборочной средней и доли. Средняя ошибка коэффициента регрессии определяется по формуле:

(8.15)

где s02 — случайная дисперсия; s 2— общая дисперсия, п - число коррелируемых пар.

Измерение тесноты связи

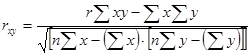

Чтобы измерить тесноту прямолинейной связи между двумя признаками, пользуются парным коэффициентом корреляции, который обозначается r

Так как при корреляционной связи имеют дело не с приращением функции в связи с изменением аргумента, а с сопряженной вариацией результативных и факторных признаков, то определение тесноты связи, по существу, сводится к изучению этой сопряженности, т.е. того, в какой мере отклонение от среднего уровня одного признака сопряжено с отклонением другого. Это значит, что при наличии полной прямой связи все значения (х —X) и (у — Y) должны иметь одинаковые знаки, при полной обратной — разные, при частичной связи знаки в преобладающем числе случаев будут совпадать, а при отсутствии связи — совпадать примерно в равном числе случаев.

Для оценки существенности коэффициента корреляции пользуются специально разработанной таблицей критических значений г.

Коэффициент корреляции rxy. применяется только в тех случаях, когда между явлениями существует прямолинейная связь.

(8.16.)

(8.16.)

Если же связь криволинейная, то пользуются индексом корреляции, который рассчитывается по формуле:

(8.17)

где у — первоначальные значения;  — среднее значение; Y— теоретические (выравненные) значения переменной величины.

— среднее значение; Y— теоретические (выравненные) значения переменной величины.

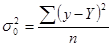

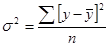

Показатель остаточной, случайной дисперсии определяется по формуле:

(8.18)

Она характеризует размер отклонений эмпирических значений результативного признака y от теоретических Y, т.е. случайную вариацию.

Общая дисперсия

(8.19)

|

характеризует размер отклонений эмпирических значений результативного признака у от

, т.е. общую вариацию. Отношение случайной дисперсии к общей характеризует долю случайной вариации в общей вариации, а

, т.е. общую вариацию. Отношение случайной дисперсии к общей характеризует долю случайной вариации в общей вариации, а

(8.20.)

есть не что иное, как доля факторной вариации

|

(8.21)

в общей, потому что по правилу сложения дисперсий общая дисперсия равна сумме факторной и случайной дисперсий:

s=sY2+s02 (8.22)

Подставим в формулу индекса корреляции соответствующие обозначения случайной, общей и факторной дисперсий и получим:

|

(8.23)

Таким образом, индекс корреляции характеризует долю факторной вариации в общей:

(8.24)

(8.24)

однако с той лишь разницей, что вместо групповых средних берутся теоретические значения Y.

Индекс корреляции по своему абсолютному значению колеблется в пределах от 0 до 1. При функциональной зависимости случайная вариация å(y-Y)2=0, индекс корреляции равен 1. При отсутствии связи R = 0, потому что Y = у.

Коэффициент корреляции является мерой тесноты связи только для линейной формы связи, а индекс корреляции — и для линейной, и для криволинейной. При прямолинейной связи коэффициент корреляции по своей абсолютной величине равен индексу корреляции:

(8.25)

(8.25)

Если индекс корреляции возвести в квадрат, то получим коэффициент детерминации

(8.26)

(8.26)

Он характеризует роль факторной вариации в общей вариации и по построению аналогичен корреляционному отношению з2. Как и корреляционное отношение, коэффициент детерминации R2 может быть исчислен при помощи дисперсионного анализа, так как дисперсионный анализ позволяет расчленить общую дисперсию на факторную и случайную. Однако при дисперсионном анализе для разложения дисперсии пользуются методом группировок, а при корреляционном анализе — корреляционными уравнениями.

Коэффициент детерминации является наиболее конкретным показателем, так как он отвечает на вопрос о том, какая доля в общем результате зависит от фактора, положенного в основание группировки.

При прямолинейной парной связи факторную дисперсию можно определить без вычисления теоретических значений Y по следующей формуле:

(8.27)

(8.27)

Множественная корреляция

До сих пор мы рассматривали корреляционные связи между двумя признаками: результативным (у) и факторным (х). Например, выпуск продукции зависит не только от размера основного капитала, но и от уровня квалификации рабочих, состояния оборудования, обеспеченности и качества сырья и материалов, организации труда и т.д. В связи с этим возникает необходимость в изучении, измерении связи между результативным признаком, двумя и более факторными. Этим занимается множественная корреляция.

Множественная корреляция решает три задачи. Она определяет:

1) форму связи;

2) тесноту связи;

3) влияние отдельных факторов на общий результат.

Определение формы связи сводится обычно к отысканию уравнения связи у с факторами x,z,w,...у. Так, линейное уравнение зависимости результативного признака от двух факторных определяется по формуле

(8.28)

(8.28)

Для определения параметров а0, а} и а2, по способу наименьших квадратов необходимо решить следующую систему трех нормальных уравнений:

(8.29.)

(8.29.)

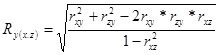

При определении тесноты связи для множественной зависимости пользуются коэффициентом множественной (совокупной) корреляции, предварительно исчислив коэффициенты парной корреляции. Так, при изучении связи между результативным признаком у и двумя факторными признаками — х и z, нужно предварительно определить тесноту связи между у и х, между у и z, т.е. вычислить коэффициенты парной корреляции, а затем для определения тесноты связи результативного признака от двух факторных исчислить коэффициент множественной корреляции по следующей формуле:

(8.30.)

(8.30.)

где rxy, rzy, rxz — парные коэффициенты корреляции.

Коэффициент множественной корреляции колеблется в пределах от 0 до 1. Чем он ближе к 1, тем в большей мере учтены факторы, определяющие конечный результат.

Если коэффициент множественной корреляции возвести в квадрат, то получим совокупный коэффициент детерминации, который характеризует долю вариации результативного признака у под воздействием всех изучаемых факторных признаков.

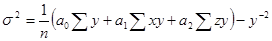

Совокупный коэффициент детерминации, как и при парной корреляции, можно исчислить по следующей формуле:

(8.31)

(8.31)

где  — дисперсия факторных признаков,

— дисперсия факторных признаков,  — дисперсия результативного признака. Однако вычисление теоретических значений Y при множественной корреляции и сложно, и громоздко. Поэтому факторную дисперсию

— дисперсия результативного признака. Однако вычисление теоретических значений Y при множественной корреляции и сложно, и громоздко. Поэтому факторную дисперсию  исчисляют по следующей формуле:

исчисляют по следующей формуле:

(8.32)

(8.32)

Проверка существенности связи при множественной корреляции, по сути, ничем не отличается от проверки при парной корреляции.

Поскольку факторные признаки действуют не изолированно, а во взаимосвязи, то может возникнуть задача определения тесноты связи между результативным признаком и одним из факторных при постоянных значениях прочих факторов. Она решается при помощи частных коэффициентов корреляции. Например, при линейной связи частный коэффициент корреляции между х и у при постоянном z рассчитывается по следующей формуле:

(8.33)

(8.33)

В настоящее время на практике широкое распространение получил многофакторный корреляционный анализ.

|

|

|